2月12日,IDC发布最新观察,称DeepSeek或成未来网卡了安全行业首选基础大模型。

IDC在观察中指出,近期,DeepSeek从激烈的“百模大战”中脱颖而出引发全球热潮,在最新的Arena全类别大模型综合排名中,DeepSeek-R1跃升至排名第三位,尤其是在风格控制类模型(StyleCtrl)的分类排名中,DeepSeek-R1与OpenAI的o1模型并列第一,这无疑凸显了其技术实力雄厚。

同时,DeepSeek也凭借其独特的优势迅速成为网络安全领域的焦点,吸引众多网络安全厂商接入。

IDC观察到,DeepSeek上线至今,已有包括安博通、安恒信息、北信源、观安信息、霍因科技、华云安、绿盟科技、奇安信、启明星辰集团、山石网科、天融信、亚信安全等在内的多家国内网络安全厂商宣布正式接入DeepSeek大模型能力并将进一步进行能力融合,越来越多的安全智能体正在尝试采用DeepSeek作为大模型底座。我们期待其在告警处理、威胁研判、知识问答、数据分类分级等方面有优异表现。

网络安全厂商为什么关注DeepSeek?

首先,DeepSeek采用的“专家混合架构”(MoE)在同等算力下实现了更高的推理效率,可显著提升实时威胁分析和自动化安全响应的能力。

其次,相比于同等规模的大模型训练成本,DeepSeek更具有优势,可最大程度节约企业成本投入,对于最终用户来讲,其部署训练及使用大模型的意愿和能力也将显著提升。

此外,DeepSeek的开源生态通过GitHub、Hugging Face等平台吸引了全球开发者参与优化与安全测试,形成了充满活力的协同创新生态。

在性能方面,DeepSeek模型在数学、代码和自然语言推理等任务上表现出色,尤其在复杂逻辑推理场景中展现了强大的深度思考能力,可为威胁检测、告警验证等场景提供更智能的解决方案。

但尽管DeepSeek在技术架构、训练成本等方面极具优势,但也暴露出了一系列典型的网络安全问题。

大模型安全问题不容忽视

正当DeepSeek在全球范围内收获大量用户和关注之际,2025年1月接连发生了大规模(Tb级别)的DDoS攻击、百万级数据泄露事件,大模型自身安全问题亟待解决。

从安全视角出发,无论何种使用场景,大模型或GenAI的使用都可能会给最终用户带来新的安全风险。例如:

训练安全;大模型训练数据质量把控不过关,使用有偏见的数据训练生成的大模型会持续输出有偏见的输出;在模型训练过程中大量高质量数据需要被集中在一起,数据泄露风险会陡然加大。

基础设施安全:大模型运行所依赖的硬件设施、软件框架、操作系统等,若存在漏洞,会极大影响大模型的稳定与安全运行。

内容安全:大模型生成内容可能存在不准确、不合规、个人敏感信息或企业机密信息以及存在侵权可能的内容;输入内容可能存在恶意攻击指令会干扰模型推理预测,造成不良后果。

应用安全:在应用层面面临传统网络安全问题和应用框架安全双重风险,如DDoS攻击、SQL注入、恶意插件、跨站脚本攻击等。

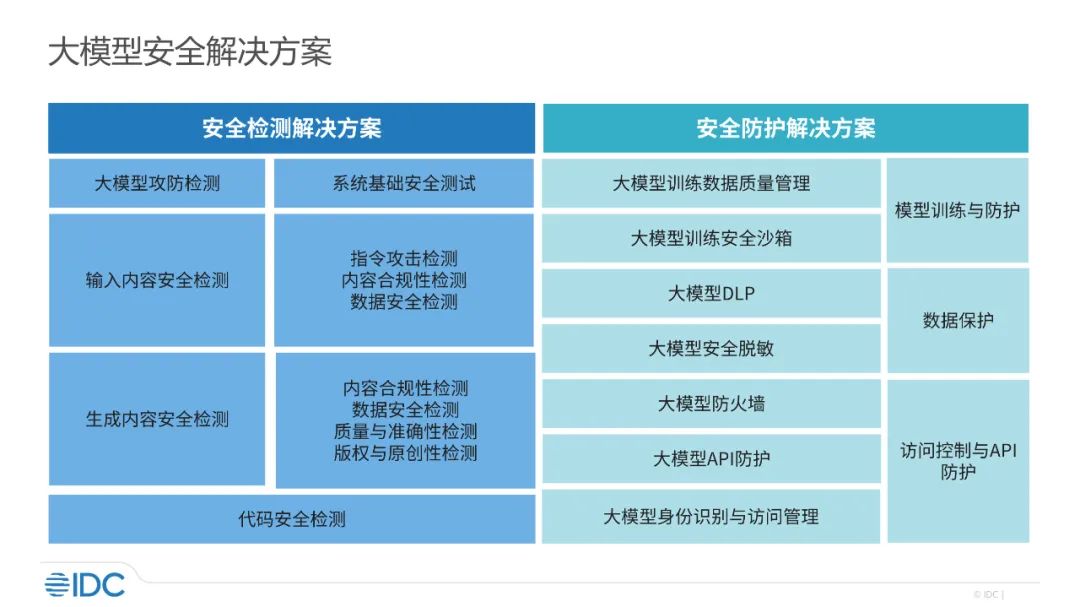

如今,已经有越来越多地网络安全公司和大模型公司将关注重点放在大模型或GenAI工具的安全能力检测以及安全防护的方向上,推出了一系列的针对大模型或GenAI工具的安全检测和安全防护解决方案,这对于人工智能技术在企业侧的深入应用具有重大意义。

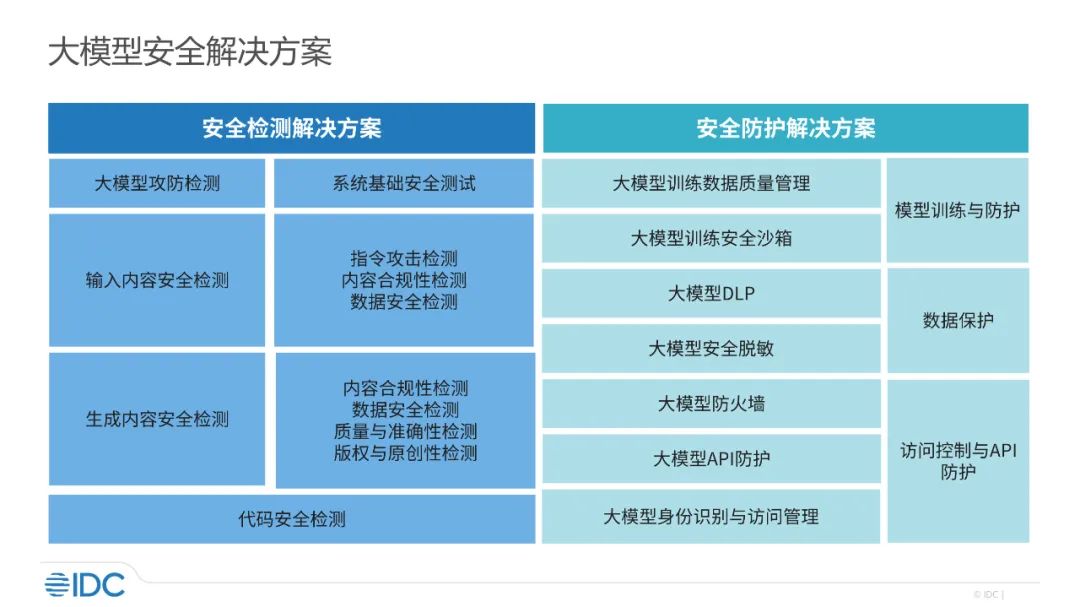

根据IDC的调研,当前大模型安全检测与防护解决方案包含了大模型攻防检测、输入内容安全检测、生成内容安全检测、代码安全检测、模型训练与防护、数据保护、访问控制与API防护几个大的方面:

图源:IDC

DeepSeek的出现再次反映出大模型时代的两面性:一方面,AI的开放性与复杂性带来了前所未有的安全挑战;另一方面,DeepSeek展现出的性价比优势与强大的推理能力或为网络安全行业AI能力提升带来新希望。

本文属于原创文章,如若转载,请注明来源:IDC称DeepSeek或成未来网络安全行业首选基础大模型https://safe.zol.com.cn/948/9486954.html